拆解 OpenClaw 核心引擎:打造生产级 Agent 系统的工程智慧

OpenClaw(原 Clawdbot)的持续走红,让 AI Agent 再次成为技术圈热议的焦点。但对于开发者和企业而言,只停留在体验层面远远不够,其背后支撑的 Agent 任务引擎,才是构建稳健生产级 Agent 系统的关键。

这款工具即便大量借助 AI 编码,其架构设计中仍藏着诸多值得借鉴的工程实践。读懂这些设计思路,才能跳出 “玩具级” Agent 的局限,真正打造出上线后稳定可用的企业级 AI 应用。今天我们就掀开 OpenClaw 的 “引擎盖”,深入剖析其 Agent 任务引擎的核心设计,从架构、调度到容错,解锁生产级 Agent 的构建密码。

教程开始~

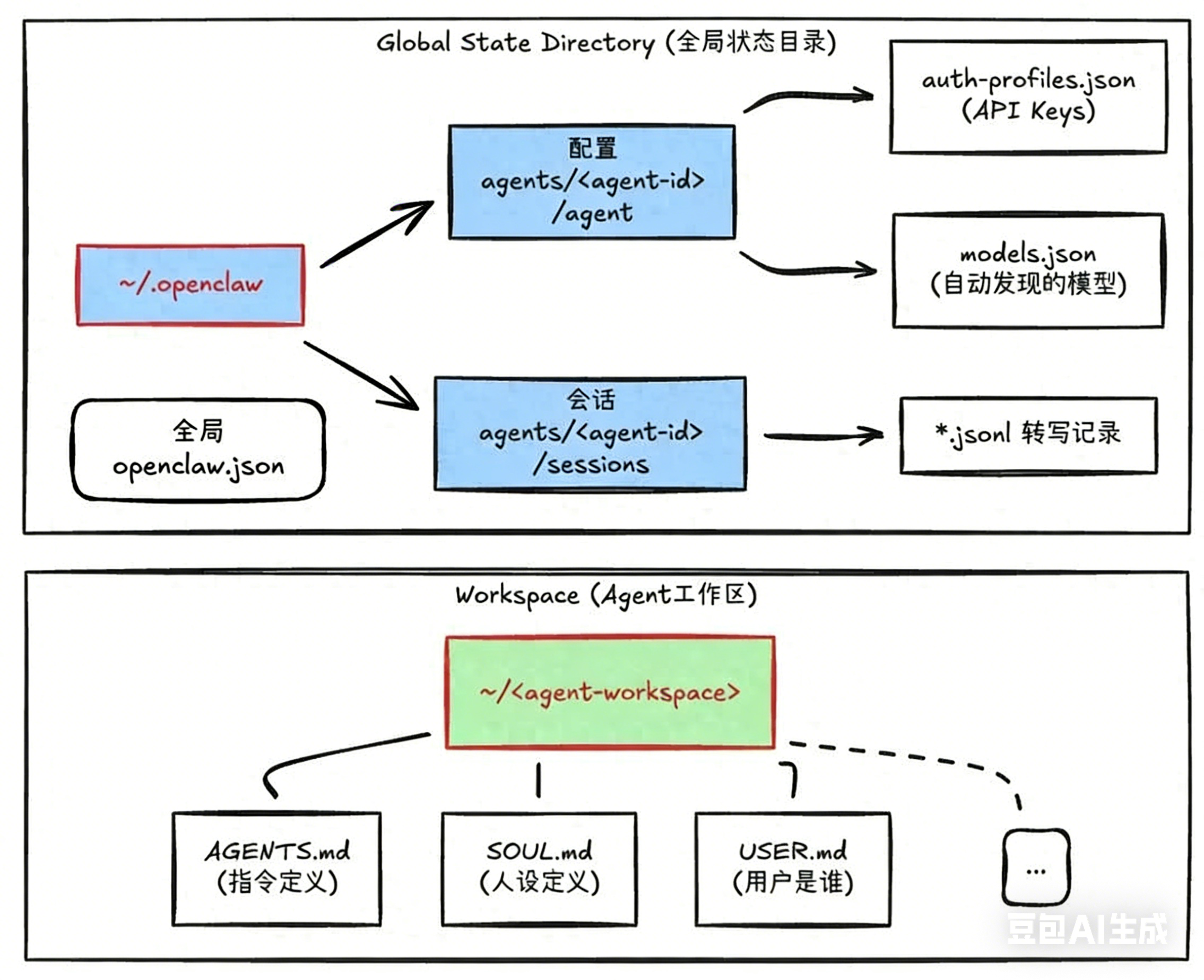

一、Agent 的 “专属工作室”:数据分离的底层设计

在 OpenClaw 的设计中,Agent 并非一个简单的任务执行模块,而是一个持久化、有状态的 “数字员工”。它不仅拥有 LLM 作为 “大脑”,更配备了专属的 “办公环境”,实现了信息的长期保存与有序管理,且每个 Agent 都拥有独立的工作区与状态区,彼此互不干扰。

这个 “工作室” 主要由三部分构成,各司其职又形成有机整体:

工作区(Workspace) 是 Agent 的 “办公桌”,可自由指定本机目录,如同 Agent 的专属 Git 库,存放 AGENTS.md 行为指令、SOUL.md 性格设定等核心配置,是 Agent 的行为准则与个性载体;

配置(Config) 存储 Agent 运行所需的敏感时配置,位于固定系统目录,专门存放敏感凭证、可用模型列表等系统级信息,属于 Agent 的 “核心机密”;

会话(Sessions) 记录 Agent 与用户的交互轨迹,存放对话历史文件,是 Agent 的记忆载体,也是其状态的重要组成部分。

这一设计的核心精髓,在于实现了用户侧与系统侧数据的严格分离。用户侧数据可自由分发与版本控制,方便将 Agent 复制到其他环境或分享给他人;系统侧数据则保持私密,API Key、会话历史等敏感信息不会因分发或迁移泄露,从底层保障了 Agent 的使用安全与灵活性。

二、分层架构设计:让 Agent 的管控与执行各归其位

OpenClaw 的 Agent 并非由客户端直接驱动,而是由指挥中枢 Gateway 统一接入与管控,形成了 “Channels-Gateway-Agent-LLM” 的分层架构。这种分层设计,让 “接入与管控” 和 “业务执行” 彻底解耦,是其能适配企业级场景的关键,也是值得所有 Agent 系统借鉴的设计思路。

各模块的分工清晰且明确:

- Channels:作为外部对接入口,负责对接 WhatsApp 等各类外部平台,实现消息的接入与格式适配,是 Agent 与外界沟通的 “桥梁”;

- Gateway:整个系统的管理与指挥中心,承担消息路由、会话加载、Skills 索引注入、工具配备等核心功能,是 Agent 的 “总调度室”;

- Agent:业务执行的核心,动态构建时间、偏好、技能、工具等推理上下文,驱动 “思考 -> 工具 -> 结果 -> 思考” 的 ReAct 循环,是任务的 “实际执行者”;

- LLM:Agent 的 “推理大脑”,接收 Agent 传递的上下文,输出下一步行动指令或最终结果,为 Agent 提供决策支撑。

当然,这种设计也存在一定代价 ——Gateway 成为系统的关键路径,若设计不当易成为性能瓶颈或单点故障,这就要求配套完善的可观测性与容灾能力,才能保障系统稳定运行。

三、调度与并发控制:破解有状态 Agent 的时序难题

对话式 Agent 的会话过程具有有状态、可能长时运行的特点,用户还会持续输入新消息,若像无状态 API 那样简单并发处理所有任务,极易导致状态损坏、上下文错乱,甚至造成大量 token 浪费。OpenClaw 通过 “车道隔离” 与 “多种队列模式”,完美破解了这一难题。

车道隔离:消除任务竞态,保证时序一致

为避免同一会话的多条消息并行处理导致的混乱,OpenClaw 为每个 Session 分配唯一的 Lane(“车道”),对应内存中的串行队列。当新消息到达时,若该车道正处于忙碌状态,消息便进入队列等待,默认保证单车道同一时间仅处理一个任务。

这种 “同一会话任务串行化” 的方式,是保障有状态 Agent 一致性的低成本高效方案。尤其当工作流涉及写操作或人类参与时,切勿轻易并发同一用户的多轮对话。当然,串行队列会牺牲单会话的吞吐能力,遇到慢任务易出现 “堵车”,企业落地时可配套超时控制、优先级策略、异步处理等机制,优化用户体验。

多种队列模式:应对高频碎片化输入,减少资源浪费

OpenClaw 的入口多来自 IM 渠道,极易出现用户碎片化连续输入的情况,若每条消息都触发一次 Agent,不仅浪费 token,还会让 Agent 的响应显得笨拙。为此,OpenClaw 在 Gateway 层设计了多种队列策略,在消息进入车道前进行前置处理,适配不同的输入场景:

- Steer(转向)模式:时间窗内的新消息注入正在运行的上一轮 Agent 循环,适合用户临时补充指令的场景,比如 “查南京天气” 后紧接着说 “要最近一周的”;

- Collect(搜集)模式:先等待时间窗结束,将窗口内的所有消息聚合成一条再交给 Agent,适配用户碎片化提问的场景,避免重复触发;

- Followup(跟进)模式:按 FIFO 顺序逐条处理,每条消息都获得完整回复,适合用户依次下达多个独立任务的场景;

- Interrupt(打断)模式:新消息到来后直接中断当前运行、清空队列,从新消息重新开始,适合用户撤销原有指令、下达新指令的场景。

简单来说,高频消息队列如同餐厅的服务员,负责整理用户的 “点餐需求”,而车道则像厨房灶台,同一时间只处理一份 “订单”。将消息缓冲与聚合前置到 Agent 之前,既能显著提升用户体验,又能减少不必要的模型调用开销,这一设计对大多数对话式 Agent 都适用。

四、高可用与容错机制:让 Agent 扛住生产环境的复杂考验

生产级系统与原型系统的核心差异,在于能否应对复杂、不可预测的运行环境。很多时候,让系统足够健壮、可容错,比追求功能强大、UI 美观更为重要。OpenClaw 从上下文管理和模型故障处理两大维度,设计了完善的高可用与容错机制,让 Agent 能扛住生产环境的各种考验。

上下文守卫机制:守住有限的上下文窗口

LLM 的上下文窗口是有限资源,多轮对话的 Agent 随着会话变长,叠加知识与工具定义后,Prompt 极易超限。若直接让 LLM 抛出 “上下文长度超限” 的错误,不仅浪费请求时间,还会导致服务直接不可用。

OpenClaw 的 Context Guard(上下文守卫)机制,构建了 “事前检查 + 事后补救” 的多阶段防线:Prompt 构建完成后、调用 LLM 前,先按阈值做 token 预检;即便通过预检,运行中触发上下文溢出,也会启动自动压缩;若压缩失败,系统会尝试重置会话并提示用户。

这里的自动压缩并非简单的消息截断,而是反向遍历消息,保留最近的部分原始消息,将更早的内容通过 LLM 压缩为结构化摘要,再拼接成新的输入。同时,其 SDK 内部还会在 token 使用量达到阈值时提前触发压缩,从源头避免报错。

当然,上下文压缩会带来一定的信息损失与摘要偏差,重置会话也可能影响交互连续性。企业落地时可根据需求配置专属的摘要策略、对订单号、金额等关键信息做保护,并建立可追溯的日志,尽量避免压缩后的推理偏差。

模型故障容错:多重保护,避免单点故障击穿服务

生产环境中,大模型 API 的不稳定性是常态:网络波动、限流、配额耗尽,甚至供应商整体故障,都可能导致 Agent 调用失败。若仅使用单一 API Key + 单一模型,系统会极度脆弱,一个单点故障就可能让整个 Agent 瘫痪。

OpenClaw 在两个层级实现了 LLM 调用的容错,为模型调用加上 “双保险”:

一是内层认证轮转,在同一个模型供应商内,配置多个 API Key 并实现自动切换,系统会不断尝试不在冷却期内的 Key,直至成功或所有 Key 耗尽,有效缓解同一供应商的短期波动;

二是外层模型降级,当某个供应商的所有 Key 都调用失败后,系统会自动降级到下一个候选模型,应对供应商整体不可用的极端情况。

这种设计思路,本质上是将 LLM 当作不可靠的外部依赖,像微服务对待下游服务一样做容错设计。不过,模型降级可能带来能力差异、风格漂移,甚至影响工具调用稳定性。企业落地时需明确模型分层与能力基线,界定哪些任务允许降级、哪些必须使用核心模型,并记录降级日志,方便后续排查与审计。

写在最后

OpenClaw 的 Agent 任务引擎,从数据分离的底层设计,到分层解耦的架构搭建,再到精细化的调度控制和完善的容错机制,每一处设计都围绕着 “生产级可用” 这一核心目标,藏着满满的工程智慧。

这些实践不仅能帮助我们更精准地理解 OpenClaw,更能为我们构建自己的 Agent 系统提供参考:无论是打造企业统一的 AI 中台,还是开发高安全级的运维机器人、大规模智能客服,都可以吸收这些设计思路,让 Agent 系统跳出 “上线即破碎” 的困境。

当然,OpenClaw 的工程实践远不止于此,其在安全与风险防御、长期记忆、模型成本优化、子 Agent 协作机制等方面,还有更多值得拆解的设计。后续我们将继续深入剖析,解锁更多生产级 Agent 的构建技巧,敬请关注!

注:本文转载自【今日头条 - AI大模型应用实践】,点击阅读原文进入原文链接