Lossless Claw:重构 AI 代理记忆的无损上下文管理系统

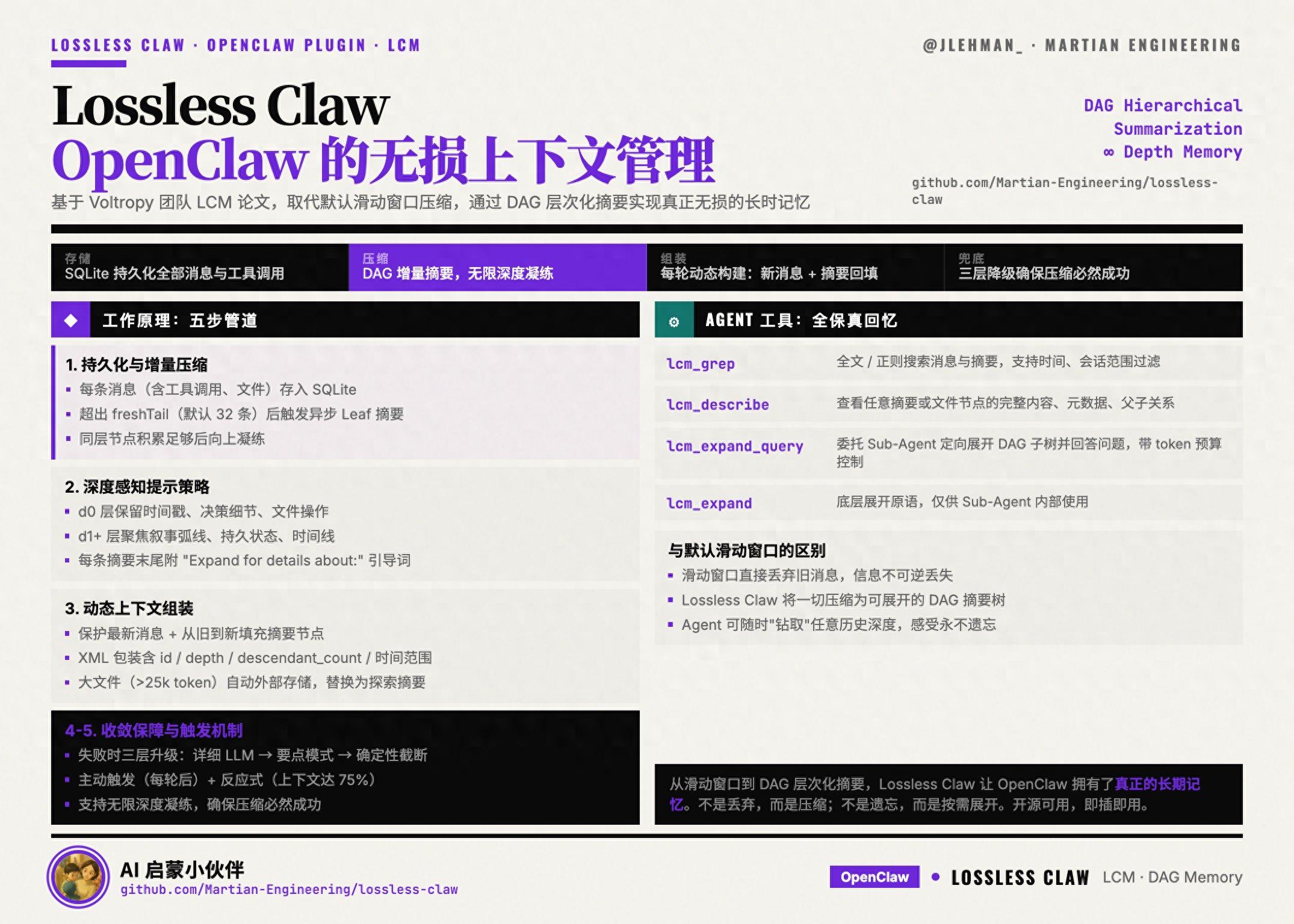

在 AI 长对话协作场景中,模型有限的上下文窗口与用户对全量历史信息留存的需求形成核心矛盾,传统的滑动窗口压缩方案会永久删除早期历史消息,导致 AI 逐渐遗忘关键细节。Lossless Claw 作为基于 DAG(有向无环图)的无损上下文管理系统,彻底解决了这一痛点,让 AI 代理实现真正的 “永不遗忘”,同时完成了 AI 与人类协作模式的基础设施升级。

核心原理:从有损压缩到无损 DAG 架构

传统压缩与 Lossless 无损压缩的本质区别

传统的有损压缩方案在消息数量超过 token 限制时,会直接永久删除早期消息,仅保留最新的少量内容,比如 10 条消息仅保留最后 2 条,其余 8 条完全丢失,导致历史信息无法追溯。

Lossless Claw 则采用分层压缩策略,在超过 token 限制时,保留最新原始消息,同时将早期消息分层生成摘要,且所有原始消息永久存储。例如 10 条消息会保留最后 2 条原始内容,将前 4 条生成摘要 B、中间 4 条生成摘要 A,当摘要累积到阈值后,再对底层摘要进一步压缩生成更高层的摘要 C,最终形成层级化的 DAG 结构,既控制 token 消耗,又实现全量信息可追溯。

DAG 有向无环图的层级结构设计

Lossless Claw 将所有历史消息和摘要组织为有向无环图结构,通过节点和有向边实现层级化管理,无环特性确保了信息追溯的有序性,避免循环依赖:

- 叶节点(Leaf):原始消息的直接摘要,保留对原始消息的追溯指针,是 DAG 结构的基础层;

- 冷凝节点(Condensed):对多个叶节点摘要的进一步压缩,实现信息的二次精简,提炼核心内容;

- 边(Edge):代表节点间的父子关系,明确底层摘要与高层摘要的归属,支持多层级的递进式压缩。

以项目需求讨论为例,4 组原始消息(各 2 条)分别生成 4 个叶节点摘要,每 2 个叶节点摘要再生成 1 个冷凝节点摘要,最终所有冷凝节点摘要汇总为项目核心需求的顶层冷凝摘要,形成清晰的信息脉络。

三大核心检索工具:精准钻取历史细节

为了让 AI 代理能快速获取历史信息,Lossless Claw 提供了三个专用检索工具,覆盖从关键词定位到原始消息回溯的全场景需求:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

架构解析:模块化设计与数据存储体系

Lossless Claw 采用分层模块化架构,各组件职责明确、协同工作,底层依托 SQLite 数据库实现全量信息的持久化存储和高效索引,整体架构从上至下分为三层:

- 核心引擎层(ContextEngine):通过engine.ts实现 ContextEngine 接口,是整个系统的调度核心,负责统筹各组件的工作流程,协调压缩、组装、检索的整体逻辑;

- 功能组件层:包含三大核心功能模块,分别实现上下文的组装、压缩和检索,是系统功能的具体落地层

- Assembler(组装):将 DAG 摘要与最近的原始消息进行组合,生成符合模型输入要求的上下文;

- Compaction(压缩引擎):通过compaction.ts执行从叶节点到冷凝节点的层级压缩,按预设规则生成各层摘要;

- Retrieval(检索引擎):通过retrieval.ts实现三大检索工具的功能,同时依托expansion.ts完成 DAG 展开逻辑,支持子代理的扩展查询;

- 数据存储层(SQLite Database):作为底层数据支撑,实现三大核心存储功能,且支持 FTS5 索引优化(可选),大幅提升搜索性能

-

全量存储原始对话消息,永不删除; -

存储分层的摘要 DAG 结构,保留节点间的关联关系; -

基于索引优化实现高效的信息检索,降低查询延迟。

配置要点:核心参数与会话持久化设置

核心运行参数

Lossless Claw 通过一系列可配置参数精准控制压缩行为和 token 消耗,适配不同的对话场景需求,核心参数及含义如下:

{"freshTailCount": 32, // 保护最近32条消息不被压缩,保留原始内容"contextThreshold": 0.75, // 当上下文占用达到窗口的75%时,触发压缩机制"incrementalMaxDepth": -1, // 层级压缩深度,-1表示支持无限层级压缩"leafTargetTokens": 1200, // 叶节点摘要的目标token数,约为4条原始消息的摘要"condensedTargetTokens": 2000 // 冷凝节点摘要的目标token数,约为4个叶节点的摘要}

会话持久化配置

系统默认采用空闲超时的会话重置策略,确保会话的合理管理,默认配置为:

{"session": {"reset": {"mode": "idle","idleMinutes": 10080 // 会话空闲7天(1440分钟/天)后重置}}}

若需适配长周期协作场景,可将idleMinutes调整为 43200,实现 30 天的会话持久化,满足长期项目的协作需求。

实战价值:赋能长周期、复杂场景的 AI 协作

Lossless Claw 的无损记忆能力让 AI 代理突破了上下文窗口的限制,在长周期项目协作、多轮复杂对话、代理自主性增强三大核心场景中展现出极高的实战价值,成为 AI 与人类深度协作的重要支撑。

长周期项目协作:全量追溯项目全流程

在跨月、跨季度的项目开发中,可实现项目信息的全生命周期追溯,解决传统 AI “遗忘早期信息” 的痛点:

- 需求追溯:项目启动阶段讨论的核心需求,在 3 个月后仍可被 AI 快速检索和精准引用,避免需求偏差;

- 技术决策:架构演进、技术选型中的关键决策点会形成结构化的知识图谱,便于团队后续参考和迭代;

- 问题复现:早期发现的 bug 报告、排查过程和修复方案可快速关联,提升问题定位和解决效率。

多轮复杂对话:完整保留对话迭代过程

在需要多轮沟通的专业场景中,可完整留存对话的全流程,实现历史信息的精准调取:

- 代码审查:跨多个 PR(代码合并请求)的讨论历史可完整追溯,便于后续代码优化和问题排查;

- 设计讨论:API 设计、产品方案等的迭代过程被全程保留,清晰还原设计思路的演变;

- 用户支持:客户的历史问题、解决方案和沟通记录形成专属知识库,后续同类问题可快速响应。

代理自主性增强:实现 AI 的自我优化与经验沉淀

Lossless Claw 的 DAG 结构让 AI 代理不再局限于孤立的对话片段,而是能基于全量历史信息实现自主进化:

- 自我反思:通过追溯历史对话,AI 可分析自身的回答偏差、问题解决思路的不足,实现自我优化;

- 经验积累:跨会话的技能和解决问题的方法可通过 DAG 结构沉淀,形成可复用的经验库;

- 上下文感知:理解对话的宏观脉络和逻辑关联,而非仅处理单个孤立的问题,提升回答的连贯性和精准性。

性能表现:高效低耗,兼顾速度与存储

Token 效率:大幅降低上下文消耗

通过分层的 DAG 压缩策略,Lossless Claw 实现了极高的 Token 利用效率,远优于传统压缩方案:

-

叶节点摘要约 1200 tokens,对应 4 条原始消息的核心信息; -

冷凝节点摘要约 2000 tokens,对应 4 个叶节点的核心信息; -

实际测试中,1000 条对话消息仅需约 10-20k tokens 的上下文,大幅降低模型的输入 token 消耗。

检索延迟:毫秒级响应,满足实时需求

依托 SQLite 的索引优化和子代理的并行处理,系统的检索延迟被控制在极低水平,适配实时协作需求:

- lcm_grep:通过 SQLite 索引加速,实现毫秒级的关键词搜索响应;

- lcm_expand:由子代理执行递归展开,根据展开深度不同,延迟约 1-2 秒;

-

可选启用 FTS5 全文搜索,可进一步优化检索性能,提升复杂查询的响应速度。

存储开销:轻量化存储,无额外负担

系统采用 “原始消息完整存储 + 摘要压缩存储” 的方式,实现轻量化的存储管理,无明显的存储开销:

-

原始对话消息完整保留,确保信息无损; -

各层摘要均经过压缩后存储,大幅减少数据体积; -

实际测试中,1000 条对话消息仅占用约 1-2 MB 的 SQLite 数据库空间,对存储设备无额外要求。

局限与挑战:现有问题与解决方案

会话重置策略的局限性

Lossless Claw 未改变 OpenClaw 原有会话重置策略,默认 7 天的空闲超时可能无法满足部分超长期协作场景。解决方案为手动调整配置,将idleMinutes修改为 43200,将会话空闲重置时间延长至 30 天,适配长周期项目需求。

首次压缩的轻微延迟

系统的压缩机制在上下文占用达到 75% 阈值时触发,首次压缩执行时会存在轻微的延迟,这是分层摘要生成的必然过程,后续压缩为增量式执行,延迟可忽略不计。

对摘要生成模型的依赖

Lossless Claw 需要依赖专用的 LLM 模型生成各层摘要(如 anthropic/claude-sonnet-4),会产生一定的模型调用成本,需根据实际使用场景平衡成本与效果,选择适配的摘要模型。

安装与使用:简单便捷的部署流程

Lossless Claw 作为 OpenClaw 的插件,安装和部署流程简单,支持线上安装和本地开发调试两种方式,具体步骤如下:

- 插件安装

-

线上正式版本安装: openclaw plugins install @martian-engineering/lossless-claw -

本地开发调试安装: openclaw plugins install --link /path/to/lossless-claw - 重启生效:执行openclaw gateway restart重启 OpenClaw,使插件生效;

- 性能优化(可选):如需提升搜索性能,可参考 FTS5 官方文档启用 FTS5 全文搜索功能。

未来展望:四大演进方向,持续升级协作能力

Lossless Claw 的核心创新为 AI 代理的记忆能力奠定了基础,未来将围绕知识共享、模型优化、可视化、自动化四大方向持续演进,进一步提升 AI 与人类的协作效率:

- 跨会话 DAG 共享:打破单个会话的限制,将个人的对话经验和知识沉淀为团队级的知识图谱,实现团队内的知识共享;

- 智能摘要模型:开发针对技术文档、代码注释、产品需求等专业场景的专用摘要模型,提升摘要的精准度和信息密度;

- 可视化界面:在现有 Go TUI 实验版的基础上,开发更友好的 DAG 结构图形化展示界面,让用户直观看到信息的层级结构和关联关系;

- 自动知识提取:从 DAG 结构的历史信息中自动提取行业规则、项目最佳实践、问题解决方法等结构化知识,形成可直接复用的知识库。

核心价值总结

Lossless Claw 通过 DAG 有向无环图的无损上下文管理设计,重新定义了 AI 代理的 “记忆” 能力,其核心价值可概括为四大核心优势:

✅ 无损:所有原始消息永久保存,通过层级摘要实现全量信息的可追溯,彻底解决 AI “遗忘” 问题;

✅ 高效:分层的 DAG 压缩策略大幅降低 token 消耗,1000 条对话仅需 10-20k tokens,提升模型上下文利用效率;

✅ 可检索:提供 lcm_grep、lcm_describe、lcm_expand 三大核心工具,实现从关键词定位到原始消息回溯的精准钻取;

✅ 透明:AI 代理可主动查询历史细节,理解对话的宏观脉络,让长对话协作更具连贯性和逻辑性。

这一技术不仅是对 AI 上下文管理的技术优化,更推动了 AI 与人类协作模式的升级,当 AI 代理拥有 “过目不忘” 的无损记忆能力后,长周期、深度复杂的人机协作将成为常态,为各行各业的智能化协作提供了全新的基础设施。

注:本文转载自【今日头条 - 心看世界Lee】,点击阅读原文进入原文链接